Blog

Vereinfachung des Zugangs zu KI durch GitHub-Modelle

GitHub ist der Ort, an dem Entwickler leben, sich austauschen und neue Dinge ausprobieren. Mit dem Boom der KI im letzten Jahr wollen immer mehr Menschen mit KI spielen und sehen, wie sie sie in ihre Anwendungen und Tools integrieren können. Es gibt eine Vielzahl von Anbietern von KI-Modellen. Einige bieten kostenlose Stufen für den Einstieg an, andere haben nur kostenpflichtigen Zugriff auf ihre Modellbibliothek. Ein KI-Modell ist ein Programm, das auf eine Reihe von Daten trainiert wurde, um bestimmte Muster zu erkennen oder bestimmte Entscheidungen ohne weiteres menschliches Zutun zu treffen. Es kann verwendet werden, um Dinge wie Text, Bilder oder sogar Code zu generieren. Ein bekanntes Beispiel hierfür ist ChatGPT, dem Sie eine Frage stellen können wie "Erstelle ein Gedicht über die Schönheit eines Waldes bei Sonnenuntergang", und das Modell wird ein schönes Gedicht erstellen.

GitHub hat mit der Funktion GitHub Models eine kostenlose Möglichkeit geschaffen, die Leistungsfähigkeit von KI zu nutzen. Mit GitHub Models erhalten Sie über die Benutzeroberfläche von GitHub Zugang zu KI-Funktionen, mit denen Sie experimentieren können, um zu sehen, was Sie damit machen können. Es gibt eine Spielwiese, auf der Sie dem KI-Modell Fragen stellen können und die Antworten in Ihrem Browser zurückerhalten. GitHub Models enthält eine Sammlung von vortrainierten Modellen, die Sie in Ihrer Anwendung verwenden können. Diese Modelle wurden mit einer Vielzahl von Datensätzen trainiert und sind sofort einsatzbereit. Sie stammen von verschiedenen Anbietern: von Meta-Llama über OpenAI, Cohere, Mistral bis hin zu Phi. Der Hauptvorteil ist, dass Sie Ihren GitHub Access Token verwenden können, um sich gegenüber den Modellen zu authentifizieren. Das gibt Ihnen viel Spielraum, um Ihre Ideen ohne zusätzliche Kosten zu testen und zu validieren.

Lassen Sie uns in die Modelle eintauchen!

Hinweis: Zum Zeitpunkt der Erstellung dieses Artikels befindet sich GitHub Models in der öffentlichen Beta-Phase, so dass in Zukunft mit einigen Änderungen zu rechnen ist.

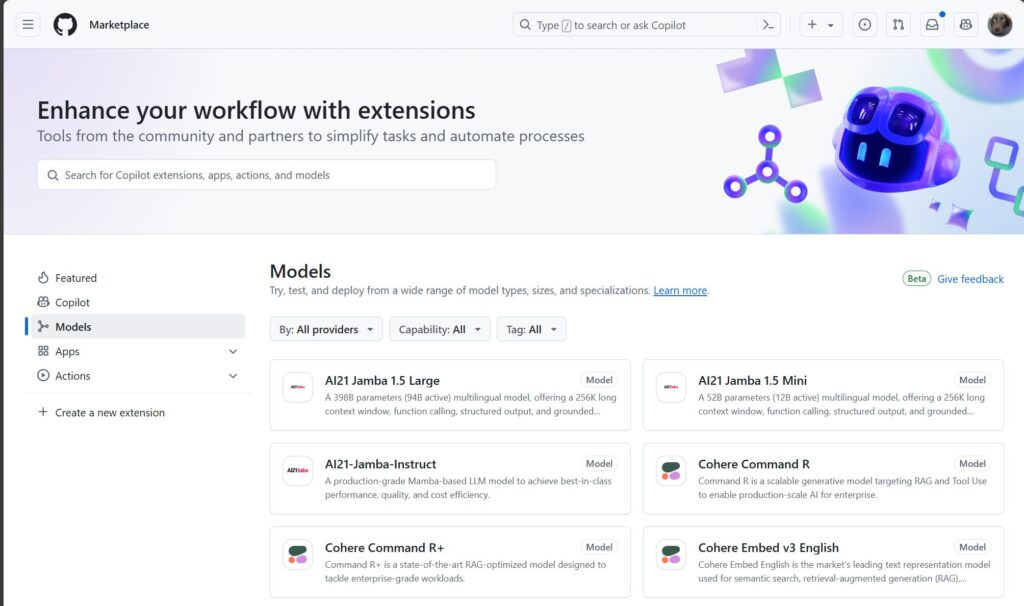

Marktplatz

Der GitHub Marketplace ist der Ort, an dem Sie eine Vielzahl von Tools finden, die von der Community angeboten werden. Das meiste davon ist kostenlos (GitHub Actions) und einige haben auch ein kostenpflichtiges Abo-Modell (einige GitHub Apps). GitHub Models ist eine neue Ergänzung des Marketplace und kann kostenlos genutzt werden. Sie können damit beginnen, indem Sie auf den Marktplatz gehen und 'Models' auswählen:

https://github.com/marketplace/models. Die GitHub Models auf dem Marktplatz sind eine Teilmenge der Azure Open AI Models.

Mithilfe der Filter können Sie nach Modellen suchen und mehr über sie erfahren. Wenn Sie auf eine Karte klicken, werden Ihnen die Details zu diesen Modellen angezeigt. Dazu gehören Links, über die Sie mehr über das Modell oder die Art und Weise, wie es trainiert wurde, erfahren können.

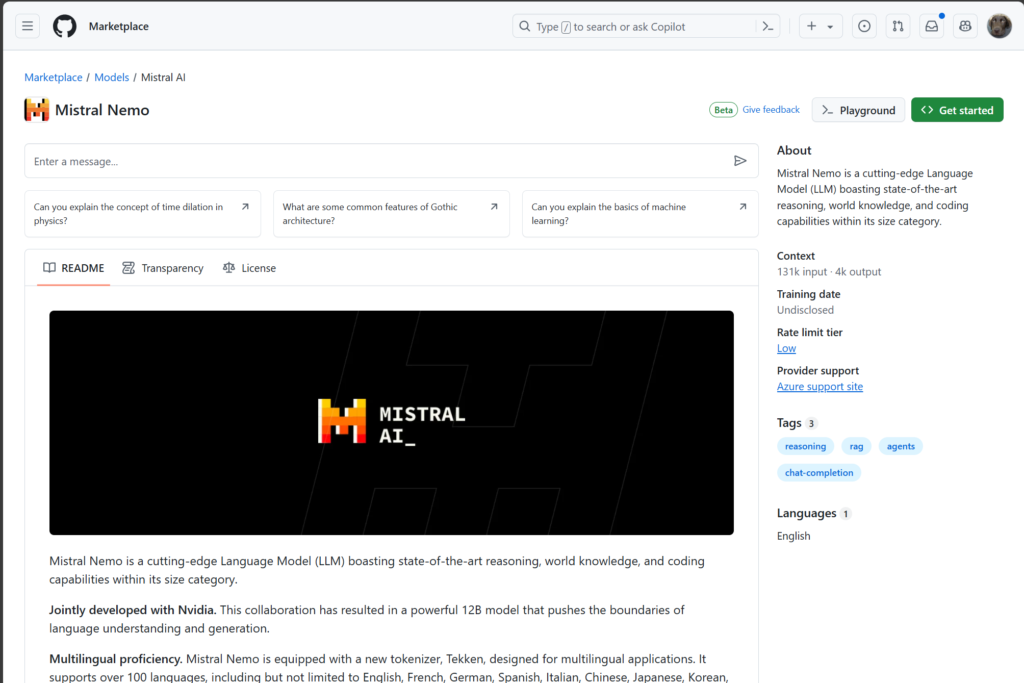

Spielplatz

Wenn Sie zur Spielwiese (oben rechts) gehen, können Sie jetzt mit dem Modell herumprobieren. Es werden bereits einige Beispiele angezeigt, damit Sie mit dem von Ihnen gewählten Modell eine Chat-Konversation beginnen können. Beachten Sie, dass Sie in der oberen linken Ecke ganz einfach zwischen den verschiedenen Modellen wechseln können!

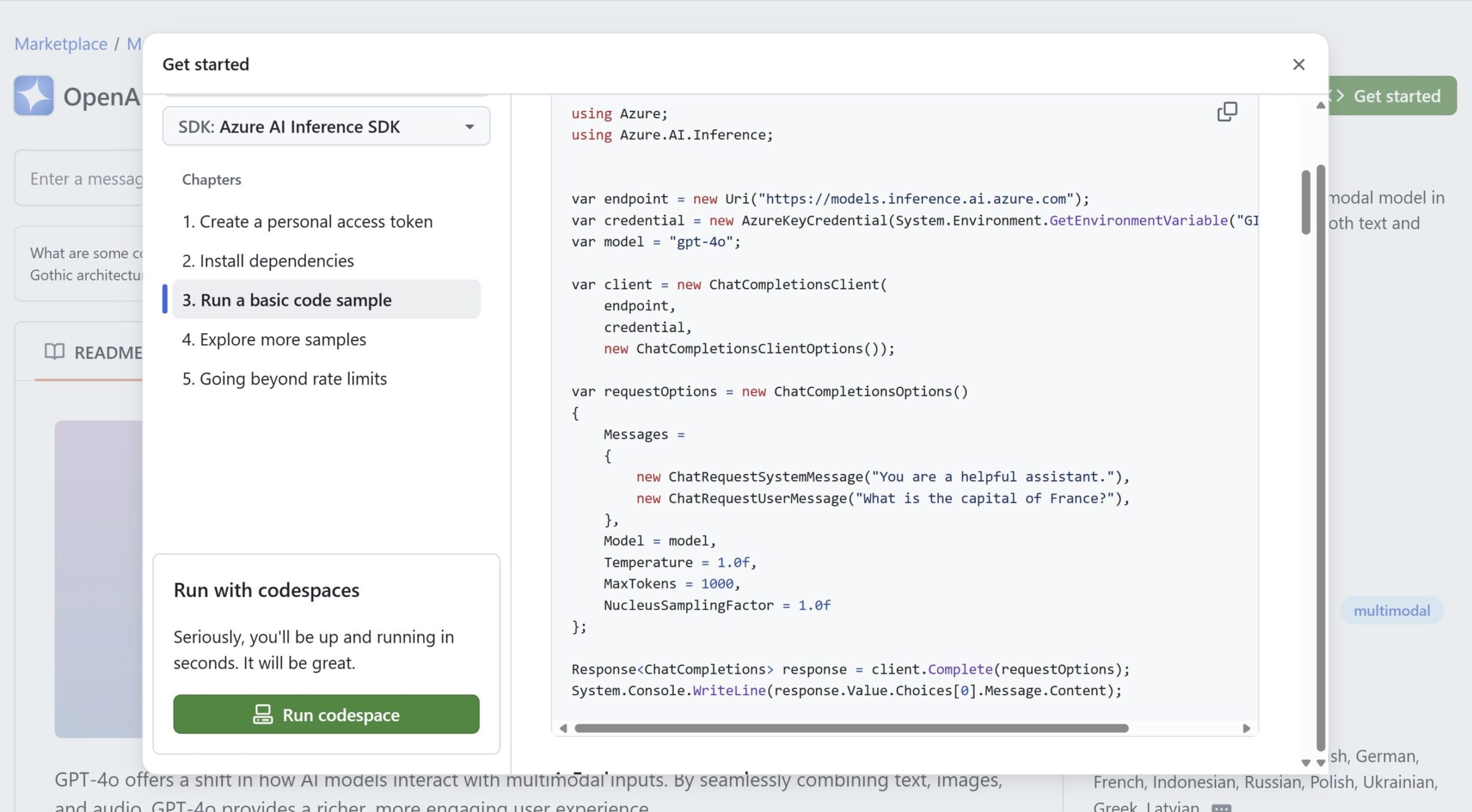

Noch besser ist, dass der gesamte Code, mit dem Sie arbeiten, auch im Spielplatz verfügbar ist. Auf der Registerkarte Code finden Sie den Code, der benötigt wird, damit der Test in der Spielwiese funktioniert. Auf diese Weise können Sie den Code einfach kopieren und in Ihre eigene Anwendung einfügen und das Modell in Ihrer eigenen Anwendung verwenden. Der Spielplatz zeigt Ihnen, wie Sie Ihren Code gegen das Modell in verschiedenen Programmiersprachen aufbauen können: Python, JavaScript, C# und REST-Aufrufe mit cURL.

Azure OpenAI

GitHub Models wurde als einfache Möglichkeit für den Einstieg in die Nutzung von KI geschaffen. Sie können wählen, ob Sie das SDK des Modellanbieters oder das Azure AI Inference SDK verwenden möchten. Die Empfehlung lautet, das Azure SDK zu verwenden, da es die Komplexität der verschiedenen Modellimplementierungen abstrahiert. Anstatt mit der Variante des Anbieters zu arbeiten, können Sie mit dem Azure SDK das Modell wechseln, indem Sie einfach den Modellbezeichner ändern.

Im folgenden Beispiel sehen Sie, wie Sie das Azure SDK verwenden, um mit dem Modell zu interagieren. Der Code ist in Python geschrieben und verwendet das Azure SDK für die Interaktion mit dem Modell. Nachdem wir den Client mit der Authentifizierung eingerichtet haben, erstellen wir eine Abschlussanfrage mit einer Systemnachricht (um die Konversation in eine bestimmte Richtung zu lenken). Danach erstellen wir eine Benutzernachricht, die wir an das Modell senden möchten. Dies wird als "Aufforderung" bezeichnet. Die letzte Zeile zeigt die Antwort des Modells, d.h. die Vervollständigung der Benutzernachricht.

client = ChatCompletionsClient(

endpoint="https://models.inference.ai.azure.com",

credential=AzureKeyCredential(os.environ["GITHUB_TOKEN"]),

)

response = client.complete(

messages=[

SystemMessage(content="You are a friendly assistent"),

UserMessage(content="Can you explain the basics of machine learning?"),

],

model="Mistral-Nemo", # change this line to use a different model

temperature=0.7,

max_tokens=4096,

top_p=1

)

print(response.choices[0].message.content)Das Ganze funktioniert so, dass GitHub die Modelle auf Azure hostet und Sie sich mithilfe Ihres GitHub-Tokens gegenüber der Implementierung authentifizieren können. Sie können diese Authentifizierung von überall aus nutzen, also nicht nur über den Playground, sondern auch in Ihrer eigenen Anwendung!

Selbst innerhalb eines GitHub Codespace (ein virtueller Arbeitsbereich, der von GitHub gehostet wird) wird die Umgebungsvariable GITHUB_TOKEN in diesem Arbeitsbereich automatisch auf den Token des Benutzers gesetzt, der den Codespace verwendet. Auf diese Weise können Sie die Modelle in Ihrem Codespace ganz einfach und ohne zusätzliche Einstellungen verwenden.

Meiner Meinung nach sehr beeindruckend! Das bedeutet, dass JEDER, der ein GitHub-Konto hat, KI-Modelle in seinen Lösungen einsetzen kann. Ganz gleich, ob Sie dies in Ihre mobile Anwendung oder Ihr Web-Backend einbauen möchten, Sie können es mit GitHub Models ausprobieren! Sie brauchen sich nicht für einen neuen Dienst anzumelden oder für ein Abonnement zu bezahlen, sondern können die Modelle einfach in Ihrer Anwendung verwenden und mit dem Testen beginnen.

Erste Schritte

Die Schaltfläche Erste Schritte führt Sie zu einem Bildschirm mit weiteren Beispielen. Die Beispiele zeigen Ihnen, wie Sie die Einstellungen, die Sie im Playground getestet haben, implementieren und in Ihre eigene Anwendung oder Ihr Repository einfügen können.

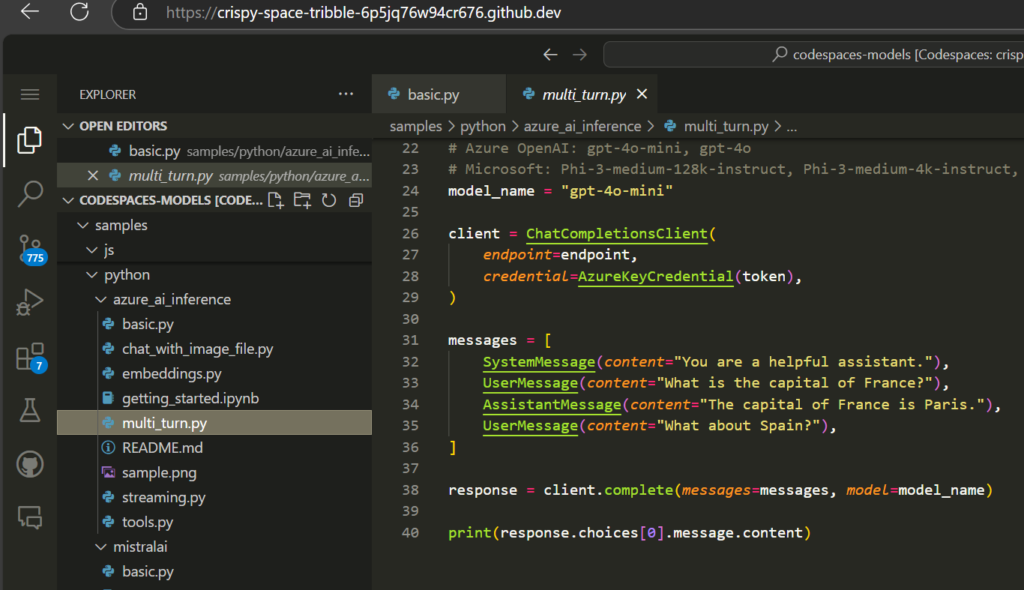

Wenn Sie auf die Schaltfläche "Codespace ausführen" klicken, erstellen Sie tatsächlich einen neuen Codespace im github/codespaces-models Repository. Ein Codespace ist eine vollständig gehostete Coding-Umgebung, die Ihnen das Herunterladen des Repositorys sowie die Installation aller Abhängigkeiten erspart. Jeder GitHub-Benutzer hat Zugang zu 60 Stunden kostenloser Codespace-Nutzung pro Monat (mit einer Dual-Core-Konfiguration). Damit können Sie die Modelle in Ihrer eigenen Umgebung testen, ohne dass Ihnen Rechenkosten entstehen.

Hinweis: Der Codespace ist eine völlig andere Erfahrung als der Playground. Der Codespace ist mit einer Vielzahl von Beispielprojekten konfiguriert, mit denen Sie beginnen können.

Der Codespace ist mit einer Vielzahl von Beispielen und Dokumentationen ausgestattet, die Ihnen den Einstieg in die Verwendung der Modelle erleichtern. Sie können die Beispiele ganz einfach direkt vom Terminal im Codespace aus ausführen und sehen, wie sie funktionieren. Da Ihr GITHUB_TOKEN im Codespace automatisch eingestellt ist, können Sie direkt zum Terminal gehen und die Beispiele ausführen.

Öffnen Sie einen Ordner in der von Ihnen bevorzugten Code-Sprache und lernen Sie die verschiedenen KI-Interaktionsmöglichkeiten kennen, die Ihnen zur Verfügung stehen:

- Einfacher Chat (eine Aufforderung und eine Antwortrunde)

- Chatten Sie mit einer Bilddatei (stellen Sie Fragen zu dem Bild)

- Einbettungen (einen Teil eines Textes abrufen, z. B. den Namen einer Stadt aus einem Satz)

- Multi-Turn-Chat (Chat-Gespräche mit Verlauf führen)

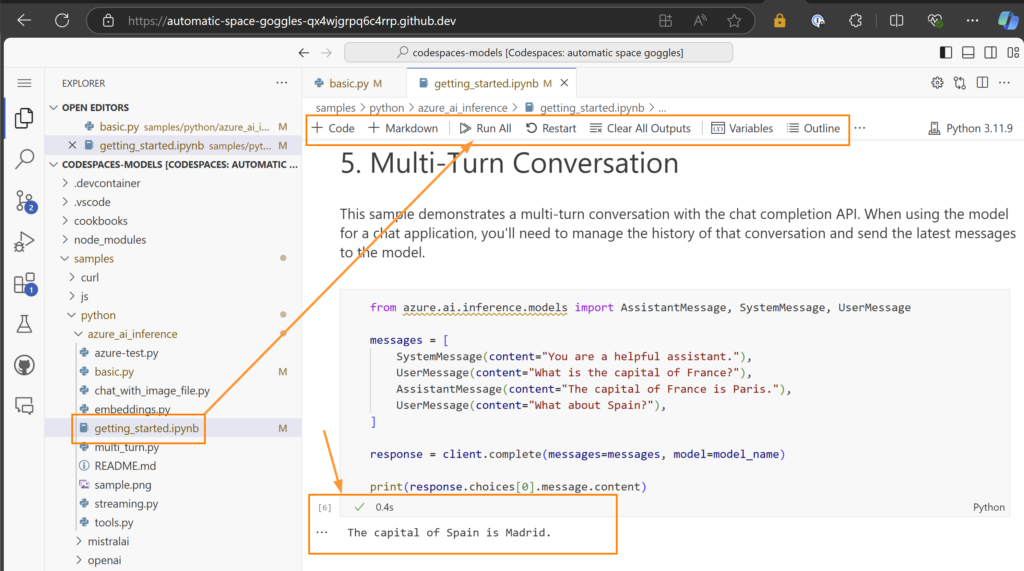

Es gibt auch mehrere Beispiele in Jupyter-Notebook-Dateien (.ipynb), die Sie im Codespace ausführen können. Ein Jupyter-Notizbuch ist in der Community für maschinelles Lernen eine gängige Methode, um Schritte in einem Prozess zu dokumentieren und eine Benutzeroberfläche zur Ausführung dieser Schritte zu haben. Die VS Code-Erweiterungen zur Ausführung des Notizbuchs sind bereits im Codespace installiert, so dass Sie das Notizbuch einfach öffnen und die Zellen ausführen können, um die Ausgabe zu sehen. Klicken Sie auf das Symbol 'Abspielen', um den Schritt auszuführen. Auf dem Screenshot sehen Sie die Benutzeroberfläche für die Ausführung der Schritte, mit der Beschreibung dessen, was in dem Schritt geschieht, dem eigentlichen Code für den Schritt und dem hervorgehobenen Ergebnis des Schritts.

Der Vorteil des Notizbuchs ist, dass diese mit viel mehr Anleitungen zu dem, was passiert, gefüllt sind. Dies ist also eine großartige Möglichkeit, mehr über den Code zu erfahren, der für die Anwendung oder den KI-Fluss benötigt wird.

Ändern Sie den Code im Notizbuch und sehen Sie, wie sich die Ausgabe verändert. Und das alles in einer kostenlosen Umgebung.

Preisgrenzen

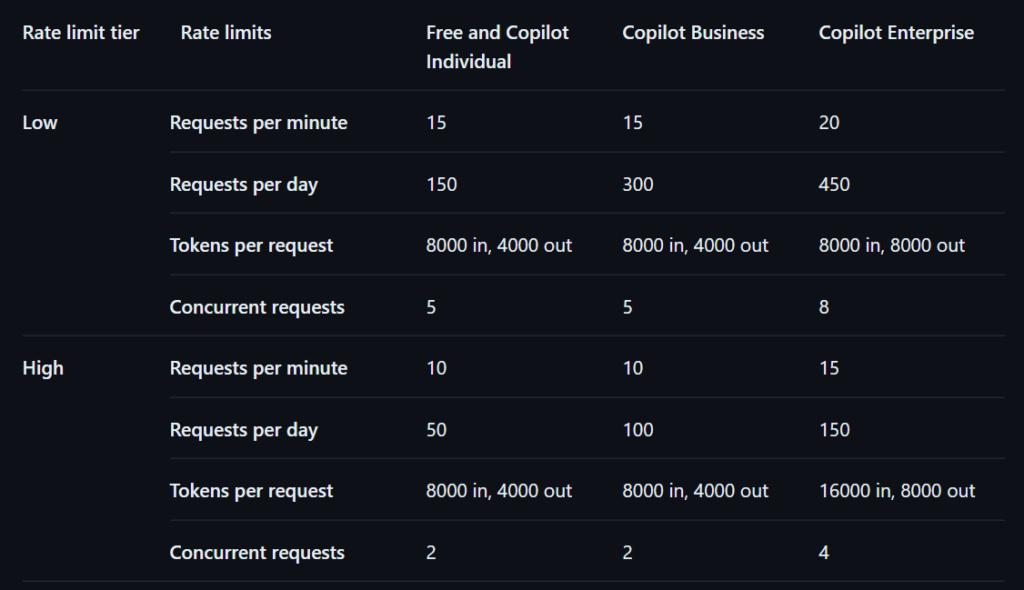

Da dies alles frei verfügbar ist, muss es einige Einschränkungen geben. Die Einrichtung ist nicht für den Produktionseinsatz gedacht, sondern für die Entwicklung und für Tests. Die Geschwindigkeitsbegrenzungen sind völlig ausreichend, um mit dem Testen zu beginnen, und geben Ihnen genügend Spielraum, um tagsüber alleine zu arbeiten.

Wie Sie im Screenshot sehen können, ist die Anzahl der Aufrufe pro Minute und Stunde davon abhängig, ob Sie bereits eine GitHub Copilot-Lizenz haben oder nicht. Das Limit für die Anzahl der Token, die in das Modell ein- und ausgehen, ist ebenfalls auf eine relativ überschaubare Menge begrenzt: 12.000 Token (in+out) reichen aus, um zu experimentieren und zu überprüfen, ob Ihre Idee funktioniert.

In die Produktion gehen

Wenn Sie genug mit den kostenlosen Optionen herumgespielt haben, ist es an der Zeit, mit einem breiteren Publikum zu testen und Ihre Lösung mit anderen Personen (z.B. Beta-Testern) zu validieren. Wenn Sie sich für das Azure AI Inference SDK entschieden haben, können Sie problemlos zu einer kostenpflichtigen Azure OpenAI-Instanz in Ihrem eigenen Azure-Abonnement wechseln. Wenn Sie sich für das SDK des Anbieters entschieden haben, können Sie zu einem kostenpflichtigen Abonnement mit dem Anbieter wechseln.

Bereitstellen auf Azure

Um Ihre KI-Integration in Azure bereitzustellen, müssen Sie zunächst eine Azure OpenAI-Instanz bereitstellen. Diese können Sie auf die gleiche Weise bereitstellen wie jeden anderen Azure-Dienst: über das Azure-Portal, die Azure-CLI oder über eine ARM/bicep-Vorlage.

Hier ist ein Beispiel für den Anfang:

# example deployment of an Azure OpenAI instance using the Azure CLI

az cognitiveservices account create

--name MyOpenAIResource

--resource-group OAIResourceGroup

--location swedencentral

--kind OpenAI

--sku s0

--subscription <subscriptionid></subscriptionid>

# deploy a model to your Azure OpenAI instance

az cognitiveservices account deployment create

--name MyOpenAIResource

--resource-group OAIResourceGroup

--deployment-name gpt-4o

--model-name gpt-4o

--model-version "2024-05-13"

--model-format OpenAI

--sku-capacity "1"

--sku-name "Standard"Wenn Sie die Azure OpenAI-Instanz bereitgestellt haben, holen Sie sich einen Schlüssel aus dem Abschnitt 'Schlüssel und Endpunkt' der Azure OpenAI-Instanz und verwenden diesen in Ihrer Anwendung. Der GITHUB_TOKEN wird dann nicht mehr benötigt. Sie müssen nur den Endpunkt und das API-Token in Ihrer Anwendung ändern, um die Azure OpenAI-Instanz zu verwenden.

Hier ist das Beispiel des neuen Codes, bei dem nur zwei Zeilen geändert wurden:

client = ChatCompletionsClient(

endpoint="https://xms-openai.openai.azure.com/openai/deployments/gpt-4o", // this line was changed, do note the deployments/deploymentname, without /models/completions!

credential=AzureKeyCredential(os.environ["AOAI_TOKEN"]), // this line was changed

)

response = client.complete(

messages=[

SystemMessage(content=""""""),

UserMessage(content="Can you explain the basics of machine learning?"),

],

model="Mistral-Nemo", # change this line to use a different model

temperature=0.7,

max_tokens=4096,

top_p=1

)

print(response.choices[0].message.content)Fazit

GitHub Models ist eine großartige Möglichkeit, um mit KI-Modellen zu beginnen. Die Nutzung ist kostenlos und Sie können die Modelle sofort in Ihrer Anwendung verwenden. Es wird empfohlen, das Azure OpenAI SDK zu verwenden, da es die Komplexität der verschiedenen Modellimplementierungen abstrahiert.

Beachten Sie, dass die Authentifizierung über Ihren GitHub Token erfolgt, mit dem Sie Ihre Tests von überall aus ausführen können. Sie sind nicht an den Playground, den Codespace oder die Ausführung in GitHub gebunden. Ich bin gespannt, was Sie mit GitHub Models bauen werden!

Dieser Artikel ist Teil von XPRT.#17. Laden Sie das Magazin hier herunter.

Verfasst von

Rob Bos

Rob has a strong focus on ALM and DevOps, automating manual tasks and helping teams deliver value to the end-user faster, using DevOps techniques. This is applied on anything Rob comes across, whether it’s an application, infrastructure, serverless or training environments. Additionally, Rob focuses on the management of production environments, including dashboarding, usage statistics for product owners and stakeholders, but also as part of the feedback loop to the developers. A lot of focus goes to GitHub and GitHub Actions, improving the security of applications and DevOps pipelines. Rob is a Trainer (Azure + GitHub), a Microsoft MVP and a LinkedIn Learning Instructor.

Contact